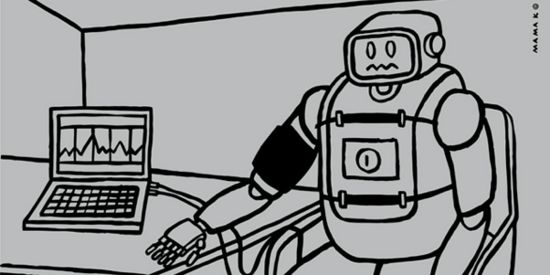

Defense Rights against Robot Testimony (PhD Project - completed)

This dissertation deals with the question of what rights must be granted to the defense so that it can subject evidence to critical examination based on an assessment made by a machine system. Machine systems that can solve complex tasks independently are used in many areas of our daily life. Some of these systems collect information about the environment via sensors, process it and make their own evaluations based on the collected data. One example is drowsiness detection systems. These can, for example, analyze the driver’s lane-keeping behavior while driving and, in the event of frequent abruptly corrected steering errors, warn the driver that he or she should take a break. They can also observe the driver’s face via cameras in the vehicle’s interior and look for signs of fatigue. Such evaluative data may, under certain circumstances, be used as evidence in criminal proceedings. For example, after a traffic accident it would be important for law enforcement authorities to know whether a drowsiness detection system installed in one of the vehicles involved in the accident warned the person driving the vehicle before the accident. If such machine evidence is used, it must be taken into account that, if “intelligent” systems work with machine learning techniques, it is often not possible to understand exactly how the system arrived at its result, even for experts. This makes it very difficult to test the reliability of the evaluative data generated by systems using such techniques. It may also be problematic that law enforcement authorities may need to be supported by the system’s manufacturer to obtain and interpret evaluative data from “intelligent” systems. This can be delicate if the manufacturer itself has an interest in the outcome of the proceedings, such as a traffic accident in which an autonomous vehicle was involved and the manufacturer could possibly be liable. Precisely because of such uncertainties, it must be clarified how the accused can defend himself against such “robot evidence” in an effective way. In particular, this raises the question of the form in which participation and confrontation rights must and can be granted in order to give the defense the opportunity to thoroughly examine the machine evidence put forward against the defendant. The Swiss criminal law already provides rights of inspection, participation and confrontation. This dissertation addresses the ways these existing rights must and can be granted in the use of “robot evidence” in order to give the defense the opportunity to thoroughly examine the “robot evidence” brought against the defendant. In doing so, this dissertation also examines how the adversarial US-criminal procedure addresses this issue. This will reveal the advantages and disadvantages of the inquisitorial system in Switzerland and the advantages and disadvantages of the adversarial system for the treatment of “robot evidence”.

Verteidigung gegen Roboterbeweise – Verwendung von KI-Ergebnisdaten als Beweise im Strafverfahren

Diese Dissertation befasst sich mit der Frage, welche Rechte der Verteidigung gewährt werden müssen, damit diese Beweise einer kritischen Prüfung unterziehen kann, die auf einer durch ein maschinelles System getroffener Einschätzung basieren. Maschinelle Systeme, die komplexe Aufgaben selbstständig lösen können, werden heute in vielen Lebensbereichen eingesetzt. Und einige dieser Systeme erfassen über Sensoren ihre Informationen über Umwelt, verarbeiten diese und treffen basierend auf darauf eigene Einschätzungen. Ein Beispiel dafür sind Müdigkeitserkennungssysteme. Diese können z.B. während der Fahrt das Spurhalteverhalten der fahrzeugführenden Person analysieren und bei gehäuften abrupt korrigierten Lenkfehlern die fahrzeugführende Person warnen, dass sie eine Pause machen sollte, oder sie können über Kameras in den Innenräumen des Fahrzeugs das Gesicht der fahrzeugführenden Person beobachten und nach Anzeichen für Müdigkeit suchen. Daten, die das Ergebnis einer durch ein maschinelles System getroffenen Einschätzung sind, könnten künftig unter Umständen in einem Strafverfahren als Beweismittel verwendet werden. Es wäre z.B. für die Strafbehörden nach einem Verkehrsunfall von Bedeutung zu erfahren, ob ein in einem der Unfallfahrzeuge eingebautes Müdigkeitserkennungssystem vor dem Unfall die fahrzeugführende Person ermahnt hat, eine Pause zu machen. Bei der Verwendung solcher «Roboterbeweise» muss berücksichtigt werden, dass bei «intelligenten» Systemen, die mit Techniken des maschinellen Lernens arbeiten, oft selbst durch Experten nicht genau nachvollzogen werden kann, wie das System zu seinem Ergebnis gelangt ist. Das erschwert die Prüfung der Zuverlässigkeit der Ergebnisdaten dieser Systeme sehr stark. Ebenfalls kann problematisch sein, dass die Strafbehörden bei der Beschaffung und Interpretation von Ergebnisdaten von «intelligenten» Systemen auf die Unterstützung des Herstellers des Systems angewiesen sein können. Das kann heikel sein, wenn der Hersteller selbst ein Interesse am Verfahrensausgang hat, wie z.B. bei einem Verkehrsunfall, bei dem ein autonomes Fahrzeug beteiligt war und bei welchem der Hersteller allenfalls haftbar sein könnte. Gerade aufgrund solcher Unsicherheiten muss geklärt werden, wie sich der Beschuldigte wirksam gegen solche «Roboterbeweise» wehren kann. Bei herkömmlichen Beweismitteln bestehen in der Schweizerischen Strafprozessordnung bereits Einsicht- Teilnahme- und Konfrontationsrechte. In dieser Dissertation wird die Frage geklärt, inwiefern diese bestehenden Rechte in bei der Verwendung von «Roboterbeweisen» gewährt werden müssen und können, um der Verteidigung die Möglichkeit zu geben, die gegen den Beschuldigten ins Feld geführte «Roboterbeweise» gründlich zu prüfen.